电脑端

应用概述

Open WebUI 是一款可扩展、功能强大且用户友好的自托管网页界面,专为完全离线运行而设计。它非常适合开发人员、研究人员以及注重隐私的个人或团队。该平台支持多种大型语言模型框架,包括 Ollama 和兼容 OpenAI 的 API。

Open WebUI 核心特性

简易部署:支持Docker与Kubernetes安装,提供便捷的镜像管理功能。

API集成:兼容Ollama与OpenAI API,支持自定义API网址,兼容LMStudio、OpenRouter等多款LLM服务。

精细化权限管理:支持基于角色的权限分配与分组管理,保障用户安全并优化管理体验。

响应式设计:适配台式机、笔记本及移动设备,支持PWA离线模式。

Markdown与LaTeX支持:丰富的格式化功能提升交互体验。

免提语音/视频通话:支持动态实时对话。

模型生成器:通过界面轻松创建和定制模型。

原生Python调用:集成代码编辑器,轻松扩展大型语言模型功能。

RAG集成:支持文档交互与检索增强生成。

网页搜索与浏览:将搜索引擎结果和网页内容整合至对话中。

图像生成:支持AUTOMATIC1111和OpenAI DALL-E等API。

多模型对话:支持并行使用多个模型以提升交互效率。

基于角色的访问控制(RBAC):确保模型与数据的安全访问。

多语言支持:支持多种语言,欢迎贡献翻译内容。

插件与管道集成:支持自定义逻辑与功能扩展。

持续更新:定期发布新功能与修复程序。

使用 Docker Compose 部署容器

在UGOS Pro系统中,建议使用项目的Docker Compose进行快速容器部署,该方案特别适用于需同时管理多个容器的场景。此方法可简化容器部署与管理流程。以下是使用Docker Compose部署Open WebUI的详细步骤。

访问 Docker 项目界面

在UGOS Pro系统中,打开Docker应用程序,点击[项目] > [创建],启动项目创建向导。

配置 Docker Compose 文件

在项目创建向导中,上传以下 Open WebUI 的 Docker Compose 配置文件:

services:

open-webui:

container_name: open-webui

image: ghcr.io/open-webui/open-webui:ollama # 镜像名称

restart: always # 重启策略

ports:

- 3000:8080 # Web服务访问端口

volumes:

- ./ollama:/root/.ollama # ollama相关数据存储

- ./open-webui:/app/backend/data # Web UI后端数据存储参数说明

image:指定要使用的 Docker 镜像版本(此处为 ollama)。

restart:容器重启策略,其中 always 表示容器停止或崩溃时将自动重启。

ports:Web服务访问端口,将NAS的3000端口映射至容器的8080端口。

volumes:将NAS文件目录映射至容器路径。

./ollama:/root/.ollama:NAS存储目录./ollama映射至容器内部路径 /root/.ollama用于存储ollama相关数据。冒号前部分为NAS存储路径。

./open-webui:/app/backend/data:NAS 存储目录 . /open-webui 被映射到容器内部路径 /app/backend/data,用于存储 Web UI 后端数据文件。

注:

./ 表示 Docker Compose 文件所在的当前目录。

冒号前的路径是NAS存储路径,冒号后的路径是容器内部的映射路径。

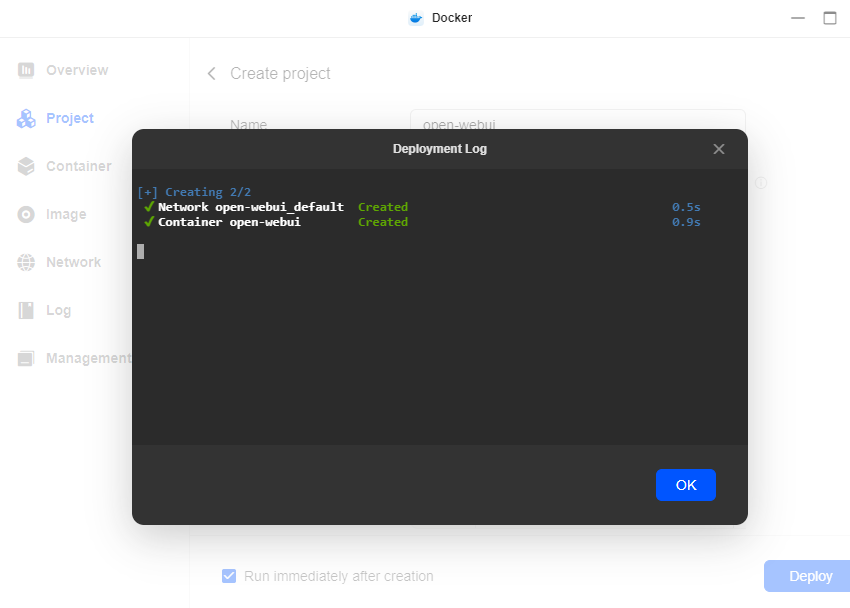

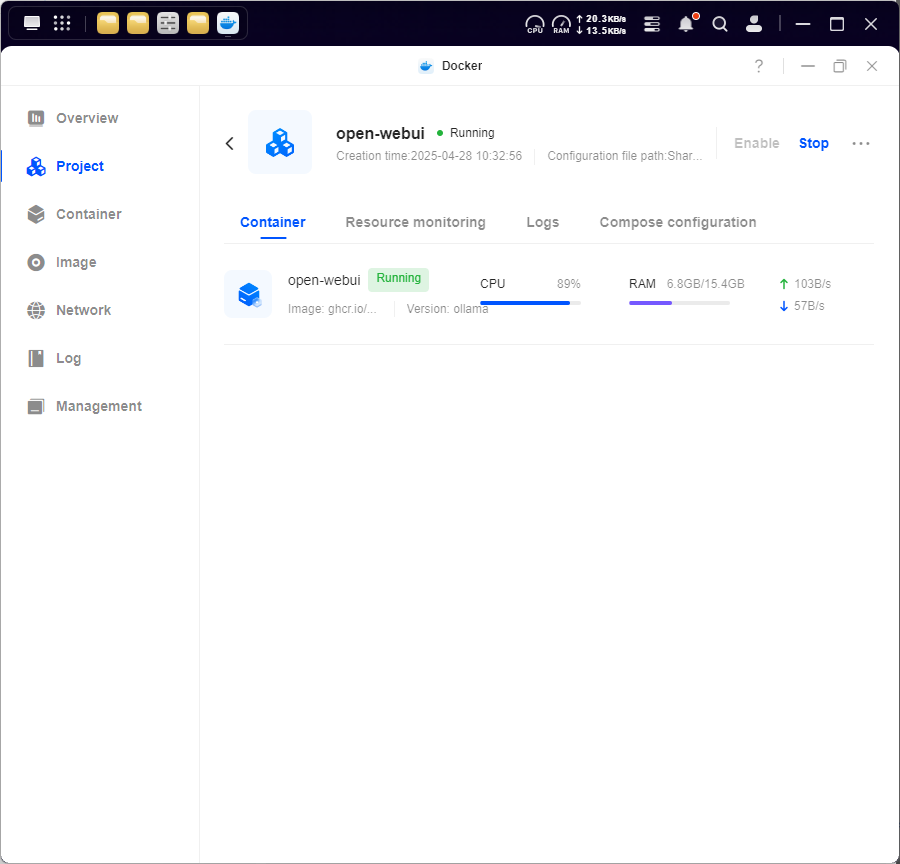

部署项目

上传配置文件后,点击[部署],系统将自动拉取镜像并启动容器。

部署完成后,请通过浏览器访问以下地址进入Open WebUI界面:

http://<NAS_IP>:3000请将 <NAS_IP> 替换为您的NAS实际IP地址,例如:http://192.168.22.153:3000。

用户指南

访问 Open WebUI 网页界面的步骤如下:

打开浏览器访问部署地址进入登录页面。

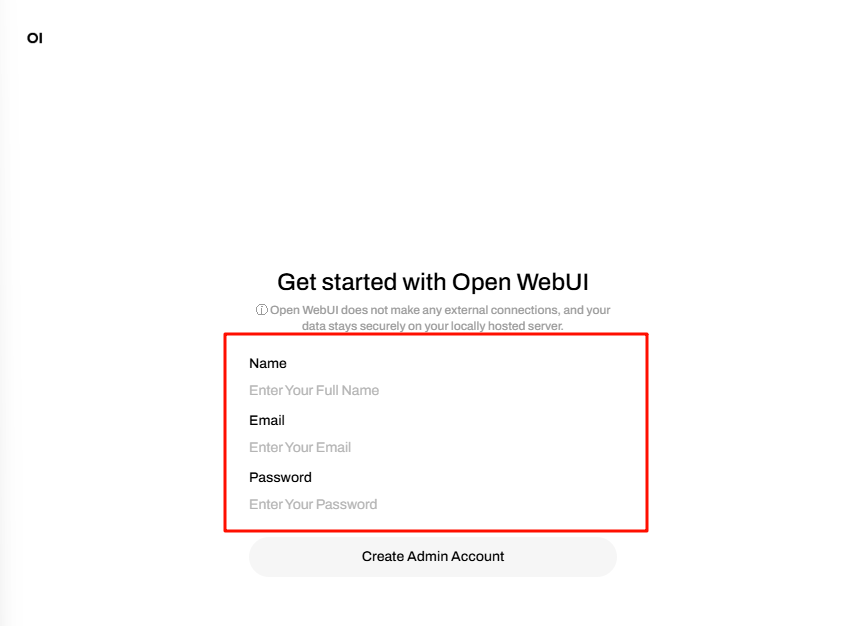

首次访问时,您需要通过设置用户名、电子邮件和密码来创建管理员账户。

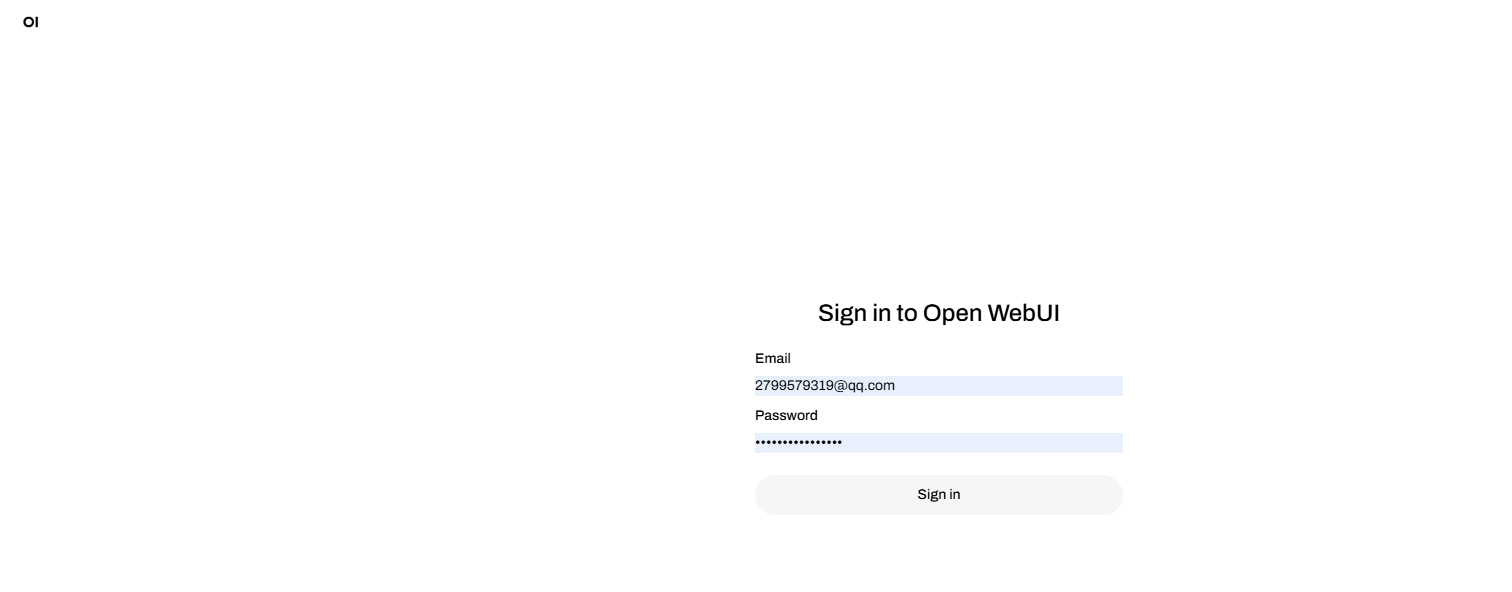

使用新创建的账户登录。

注意: 部署后页面可能初始显示内部错误或连接拒绝。请等待数分钟直至页面加载完成。

空白页面问题解决方案

首次登录Open WebUI时可能出现空白页面,这是系统等待OpenAI模型返回数据时的延迟现象。若不想等待加载过程,可通过禁用OpenAI API解决此问题。请注意:禁用OpenAI API操作仅应在界面首次成功加载后进行。

解决方案步骤:

首次登录时,系统将尝试连接OpenAI模型并加载相关数据,可能导致短暂空白页面。请耐心等待加载完成。

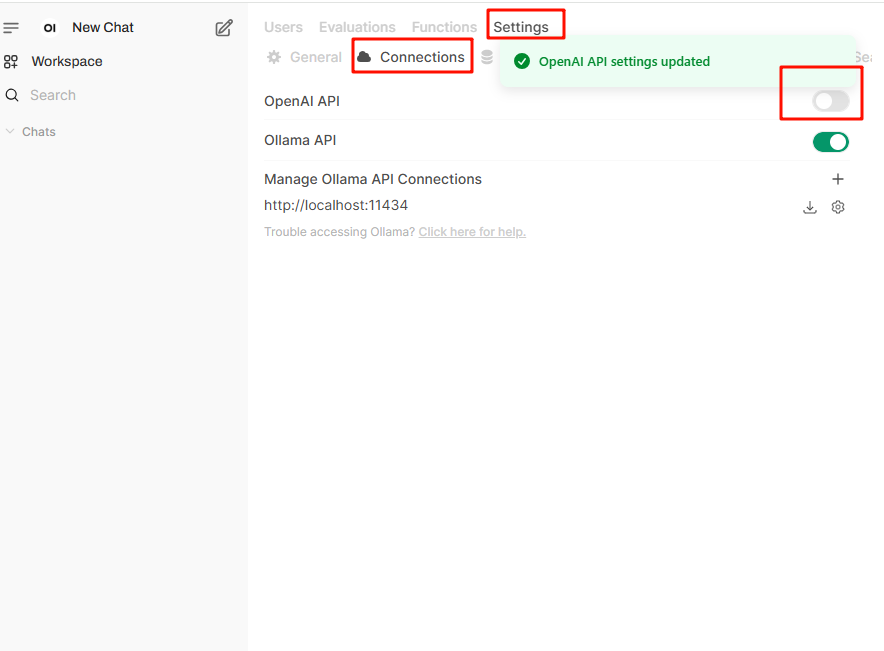

登录并完成加载后,进入"管理面板"。

在"管理面板"左侧菜单中点击"设置"。

在"设置"页面选择 "连接"选项。

在"连接"设置页面中,您将看到"OpenAI API"配置选项。

禁用"OpenAI API"选项。禁用后,Open WebUI在下次加载时将不再等待OpenAI模型的返回数据。

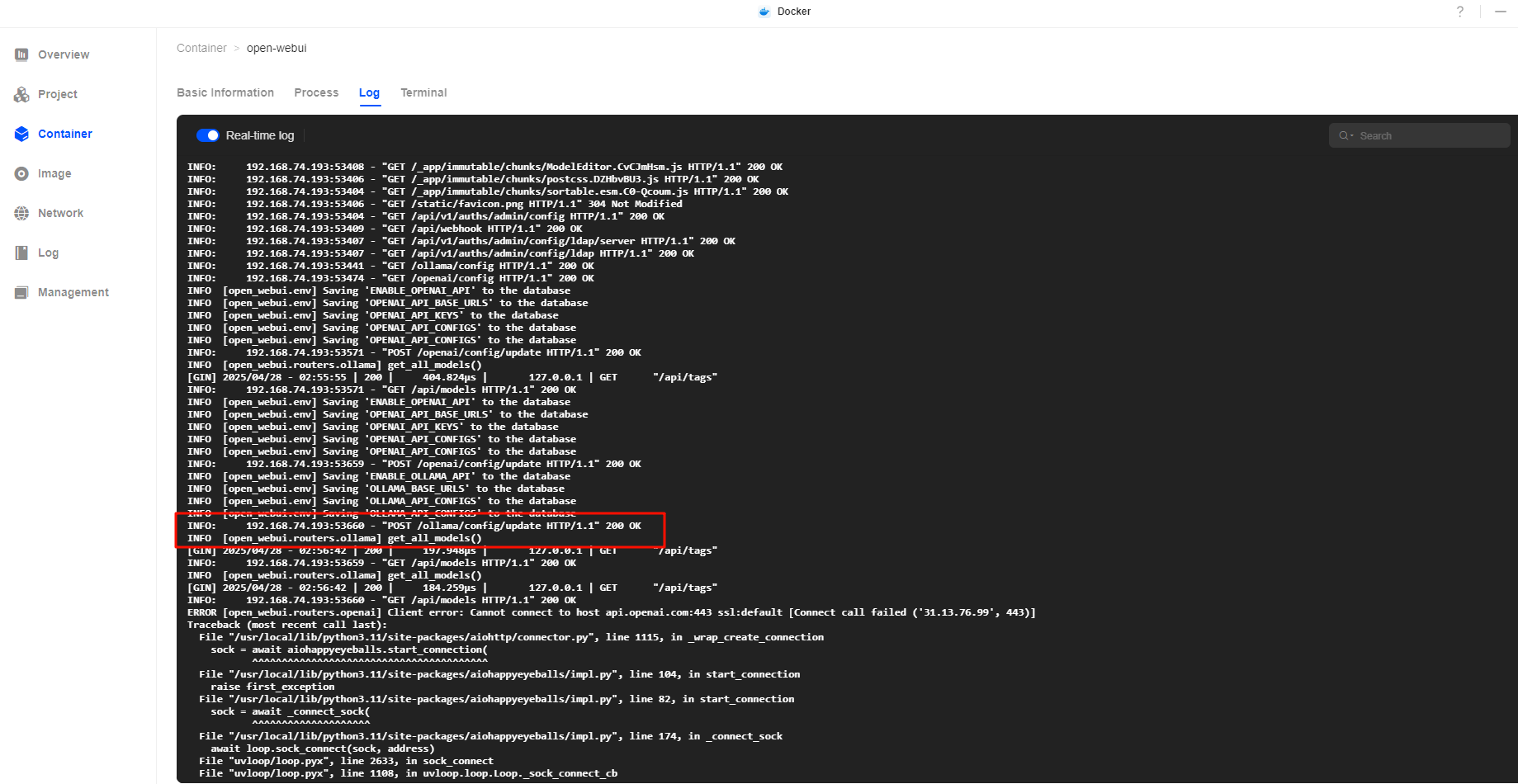

您也可通过检查相关日志文件判断加载过程是否正常。具体步骤如下:

进入UGOS Pro中的Docker应用程序。

点击[容器] > 选择Open WebUI容器 > 点击[日志]。

检查日志中与模型加载相关的进度信息,如"get_all_models"或"Loading models"。若日志显示加载正常,请等待数分钟后刷新界面;若出现错误信息,请参照日志内容排查问题。

检查日志确认加载进度,等待数分钟后刷新页面。

下载与部署模型

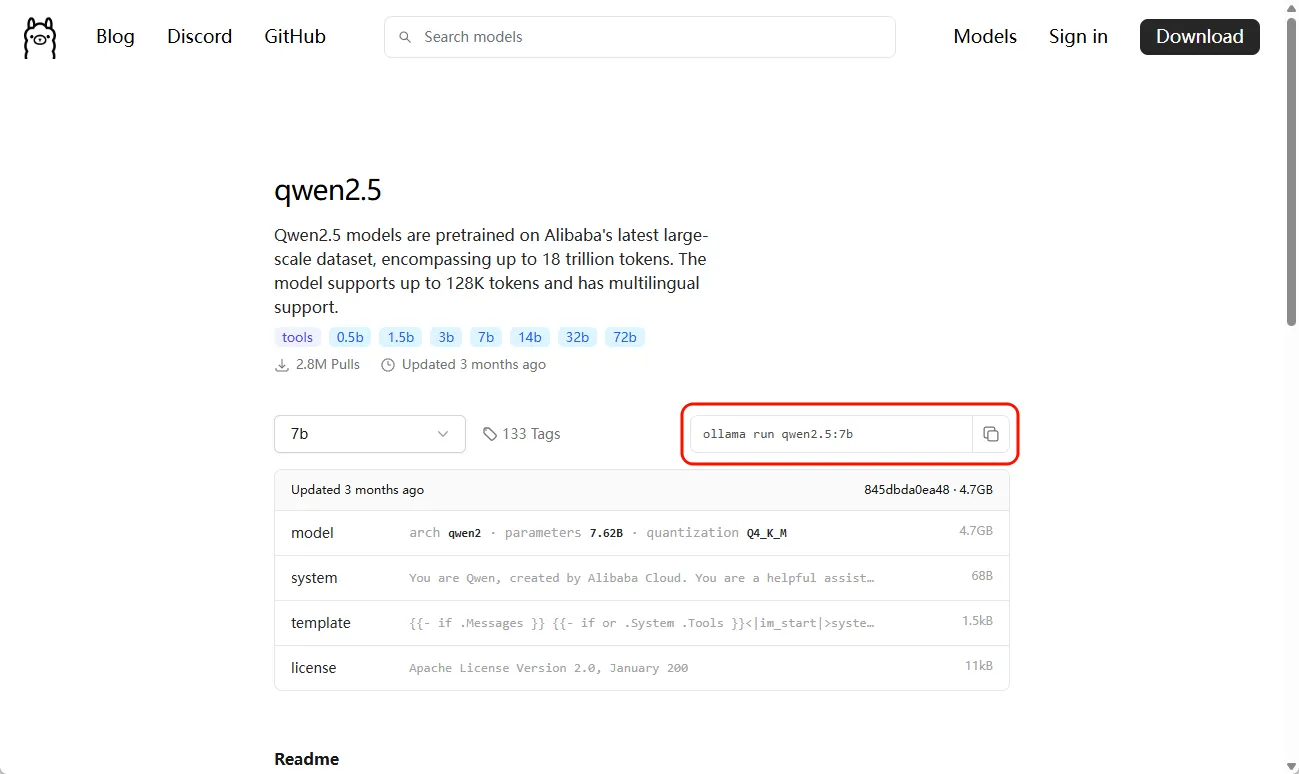

打开 Ollama 模型库 查看支持的模型。

选择所需模型并复制拉取命令(例如:

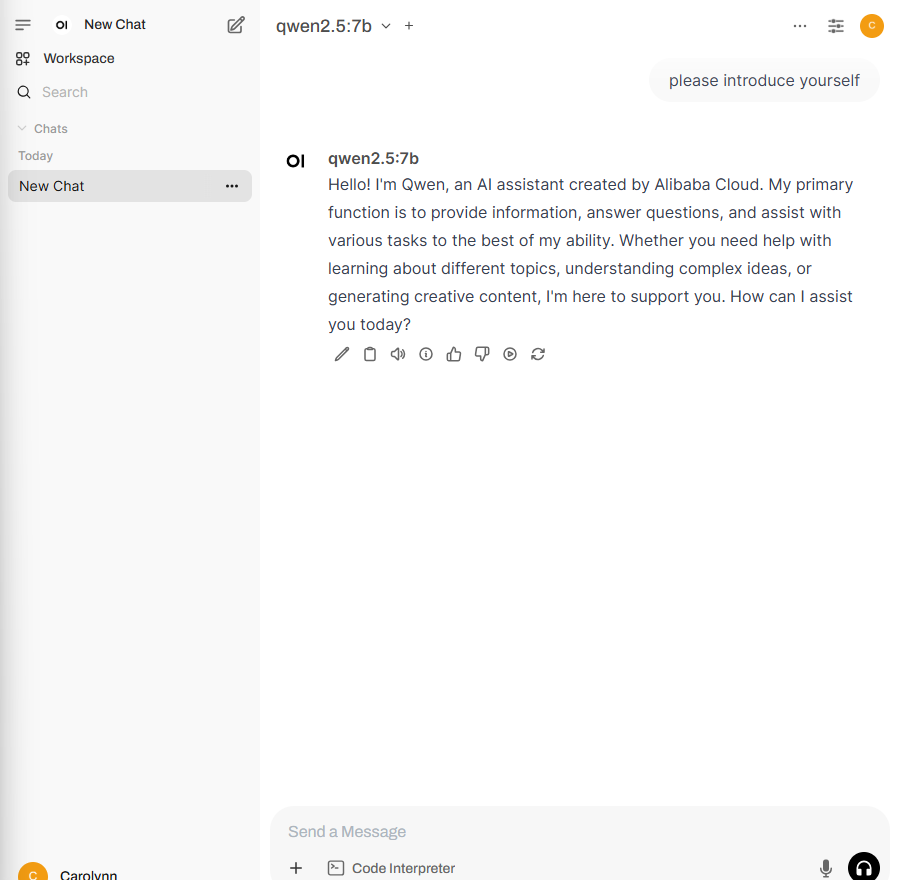

ollama run qwen2.5:7b)。

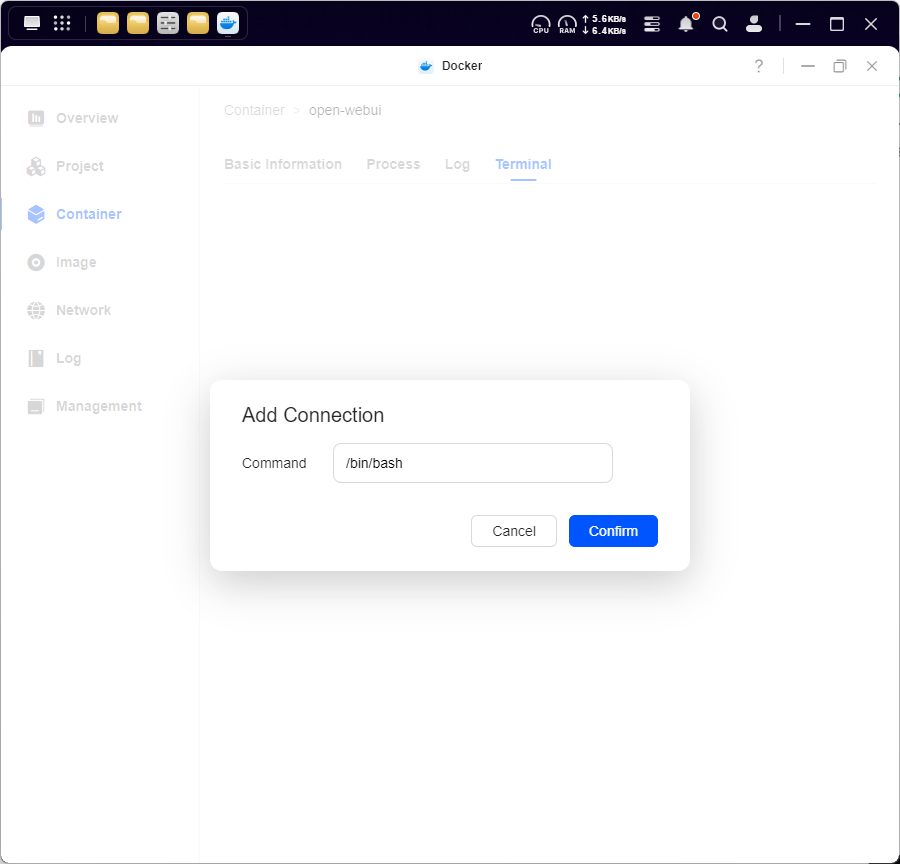

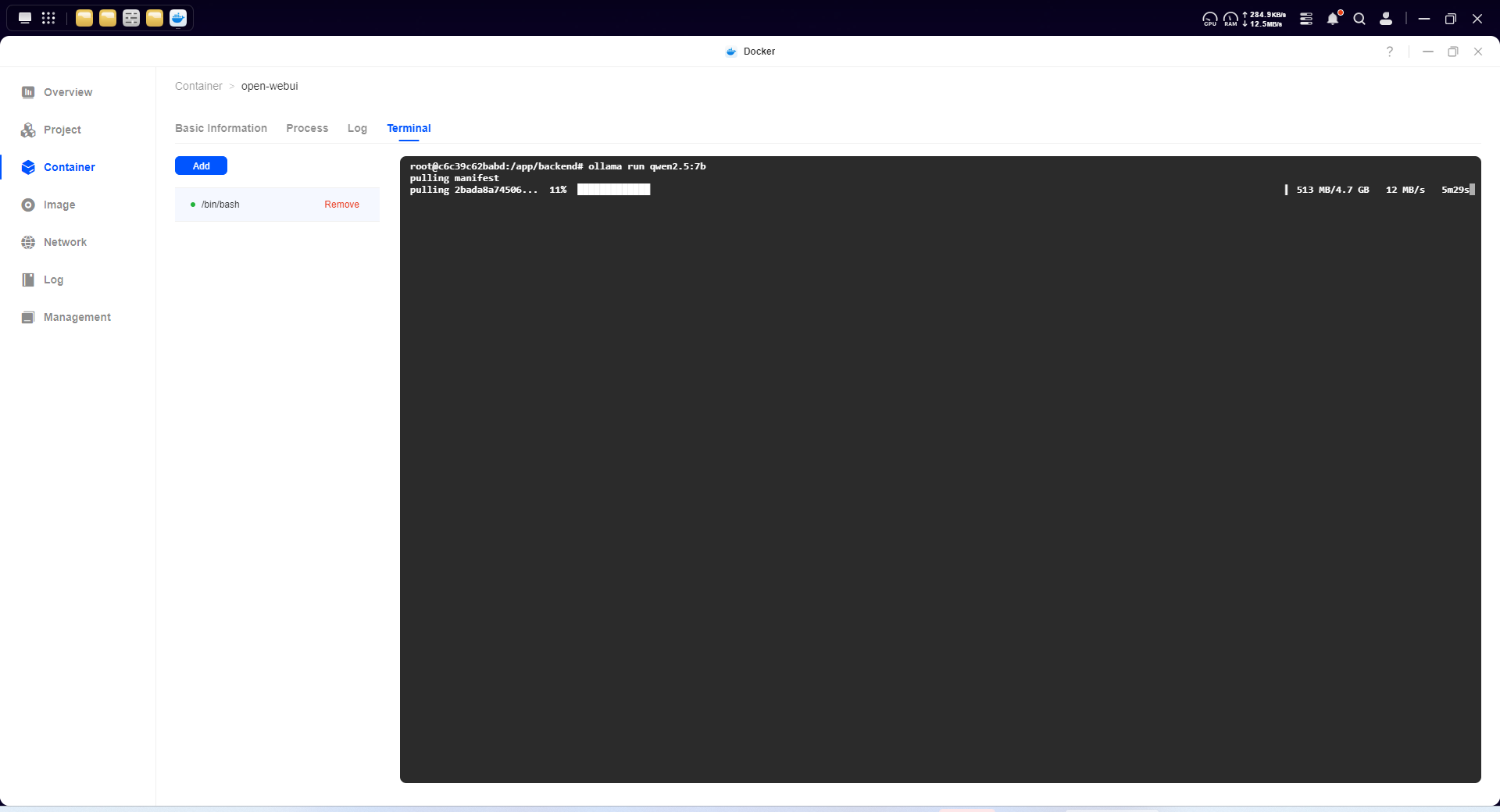

返回UGOS Pro中的Docker应用程序,进入[容器] > 选择Open WebUI容器 > 点击[终端] > 添加新的Bash连接。

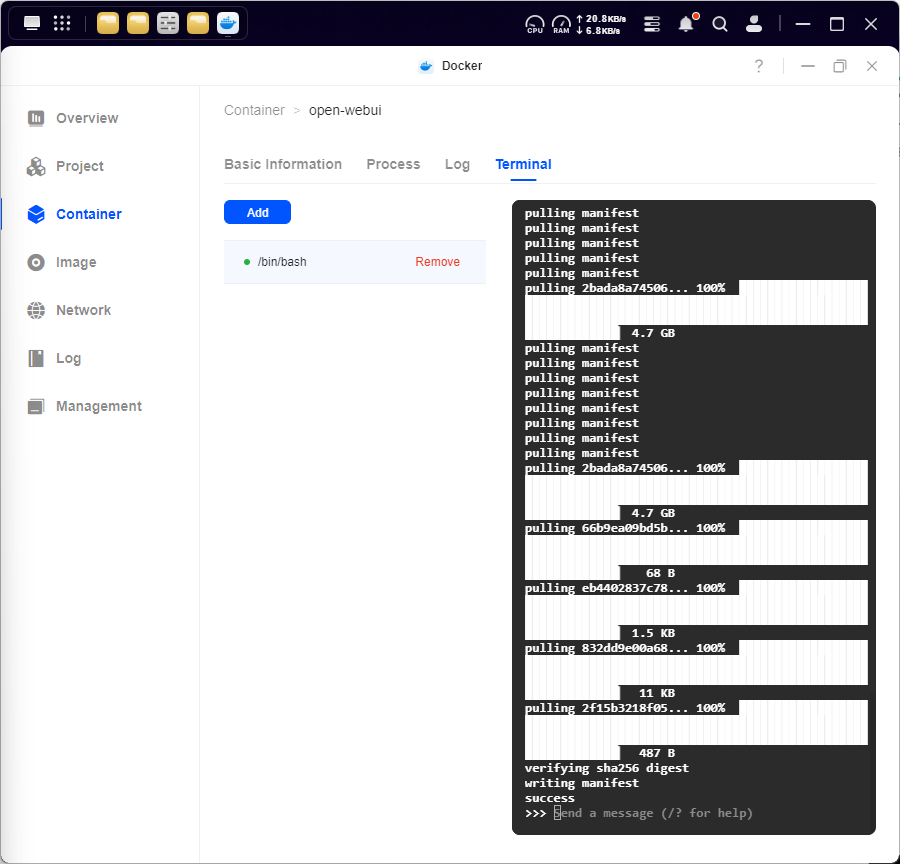

在 Bash 终端粘贴拉取命令,等待模型下载完成。

ollama run qwen2.5:7b

若显示"success",表示模型已成功下载。重启容器。

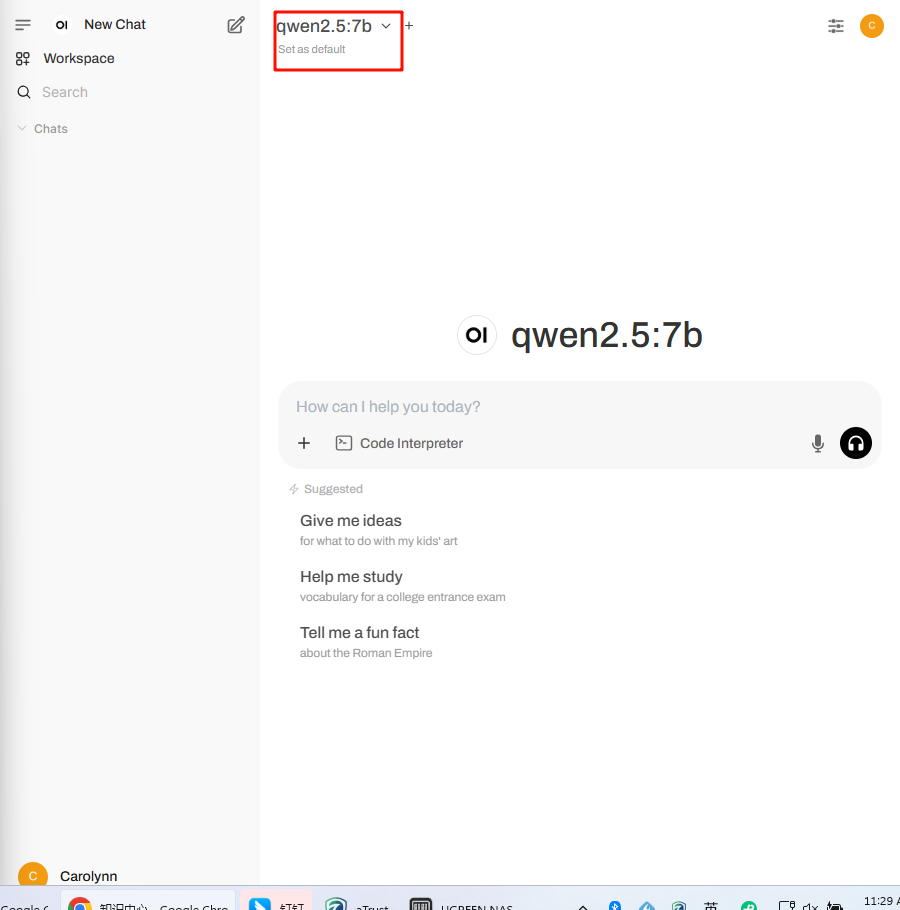

登录 Open WebUI 确认模型是否成功加载。

模型使用指南

在新对话中要求模型自我介绍,即可确认其已准备就绪。

使用提示

部署大型模型将显著增加NAS的CPU和内存负载。建议避免在高负载任务期间使用。

在绿联 NAS 上配置Open WebUI以部署大型语言模型

https://www.zzssp.com/archives/Open-WebUI

评论